Inteligencia artificial

70 voces de la academia piden la moratoria de sistemas de reconocimiento facial

Hoy se publica una carta enviada al Gobierno, firmada por 70 personas del ámbito tecnológico, en la que reconocen “la necesidad de de establecer una moratoria en el uso y comercialización de sistemas de reconocimiento facial por parte de empresas públicas y privadas”. La razón principal es la falta de legislación aplicada al uso de estos sistemas, que se ha disparado considerablemente en los últimos 10 años. “Existe una variada gama de razones que justifican la creación de una comisión para investigar esta necesidad”.

En febrero de 2021 Renfe anunció una licitación de sistema de reconocimiento facial para aplicar en 25 estaciones de distintas ciudades del estado que, en principio, serviría para detectar excesos de aforos y personas colándose la estación durante su primera fase de aplicación. La polémica salta cuando la compañía publica que, durante su segunda fase, el sistema debería “analizar la conducta de los usuarios” para reconocer “tumultos, peleas o comportamientos anómalos, como huelgas o manifestaciones”, así como la identificación de personas por “edad, género, origen étnico, tipo de ropa o estado de ánimo”.

El principal problema que presentan estos sistemas, que deberíamos anteponer ante todos los demás por su orden operativo, es que son “cajas negras”, es decir, no existe ningún organismo que audite ni controle su funcionamiento

Renfe retiró rápidamente el anuncio, pero su publicación ya había desencadenado la escritura de esta carta por parte del equipo promotor, compuesto por Ujué Agudo, David Casacuberta, Ariel Guersenzvaig y Karlos G. Liberal. “Sistemas similares ya están disponibles para entornos educativos, laborales, sanitarios, de ocio y muchos otros, tanto públicos como privados”, señalan.

“Esta idea llevaba mucho tiempo apareciendo en conversaciones con los otros promotores de la carta cuando nos encontrábamos en talleres, conferencias o hackmeetings” relata a El Salto Karlos G. Liberal, desarrollador informático y promotor de la carta. “El tema de la Renfe fue el desencadenante por las absurdeces que decía. Aunque a veces son globos sondas que lanzan las compañías para probar la respuesta de la población”. Tras redactar el primer borrador de la carta, el equipo de la envió a un entorno más cercano, entre las que destacan Ana Matute, Ana Valdivia o Manuela Battaglini, para que participasen en la redacción de la carta. “Otro de los eventos que nos animó a escribirla fue la noticia de que el gobierno de Estados Unidos había rescindido el contrato de reconocimiento facial en cámaras de la policía, ya que les daba más problemas que beneficios”.

“Los algoritmos de aprendizaje automático que los sustentan tienen graves problemas que han sido ampliamente documentados y discutidos por la comunidad científica y y entidades gubernamentales y civiles”

La hoja de ruta de esta carta pasa por las manos de Carme Artiagas, científica y empresaria del ámbito de las nuevas tecnologías que Nadia Calviño ha nombrado como secretaria de Estado de Digitalización e Inteligencia Artificial. “Nos gustaría llegar a tener una conversación con los responsables públicos para crear un grupo de investigación que evaluase los problemas detallados en la carta”, añade Liberal. “Se han sumado también voces del ámbito de las ciencias sociales, la filosofía o del mundo de la empresa. Es importante, ya que no se trata de un problema que nos afecta a todos y atraviesa varios campos de análisis”.

Una de las firmantes de esta carta es Gemma Galdón, presidenta de la Fundación Éticas, que ya explicó a El Salto en una entrevista anterior que los mecanismos legales para controlar el uso de estas tecnologías ya existen amparados en la Ley de Protección de Datos Europea, y el problema reside en que no se aplican y tanto administraciones públicas como privadas pasan por encima de ellos.

El principal problema que presentan estos sistemas, que deberíamos anteponer ante todos los demás por su orden operativo, es que son “cajas negras”, es decir, no existe ningún organismo que audite ni controle su funcionamiento. Debemos preguntarnos antes que nada, ¿realmente puede una máquina discernir mi estado de ánimo? Las únicas entidades que saben realmente cómo funcionan son las empresas que los diseñan. Por lo tanto, el primer escollo reside en que no sabemos si están haciendo lo que realmente dicen que hacen.

Si escarbamos un poco en la superficie del discurso de vendedores de crecepelo que tienen estas compañías, muchas veces nos encontramos con una maqueta, como le ocurría a Arturo cuando llegaba a Camelot en Los caballeros de la mesa cuadrada. Esto es lo que ha ocurrido, por ejemplo, con iBorderCtrl, un sistema de detección de mentiras encargado por la Unión Europea para detectar traficantes y falsos refugiados en sus fronteras que tuvo que retirarse por los problemas que generaba. La compañía que lo diseñó había “entrenado” al algoritmo de reconocimiento de mentiras con actrices y actores que debían actuar como si fuesen traficantes.

“Lo más urgente es que el Gobierno realmente se cuestione el uso de estos sistemas biométricos en espacios públicos. Margarita Robles ha licitado un sistema biométrico para controlar el horario del personal en un hospital militar”, señala Ana Valdivia, una de las firmantes, investigadora asociada del King’s College de Londres. “Lo más peligroso, bajo mi punto de vista, es la opacidad con la que estos sistemas operan. No existe rendición de cuentas, en muchas ocasiones no se sabe qué empresas los desarrollan, cuánto dinero reciben, qué algoritmos utilizan, con qué datos, qué métricas obtienen para evaluar los algoritmos tanto dentro del laboratorio como en la vida real una vez ya implementados”, añade.

El periodista e investigador Ekaitz Cancela publicaba en El Salto recientemente cómo la empresa privada Eurocop Security Systems ganaba más de 100 contratos públicos para promocionar sistemas de software y soluciones automatizadas destinadas a “aumentar la eficacia y productividad de los servicios de policía”. Otro de los problemas que se añaden a los citados en la carta es el gasto y el peso que suponen para el erario público, ya que muchas de estas empresas desarrollan sus sistemas financiadas con dinero público.

La fantasía de la predicción

Suponiendo que estos sistemas llegasen a funcionar realmente tal y como los venden los CEOs de las compañías que los diseñan, desde la carta señalan que “los algoritmos de aprendizaje automático que los sustentan tienen graves problemas que han sido ampliamente documentados y discutidos por la comunidad científica y y entidades gubernamentales y civiles”. Además aun atendiendo a las cifras de éxito que ofrecen estas compañías, cuestiones como la variabilidad de luz respecto a la que se usa durante el entrenamiento de estos sistemas, o el color de la piel de los sujetos, aumentan considerablemente las tasas de error según expone la carta.

"España tiene una de las mayores tasas de paro en la población juvenil. Lo primero es lo primero. Así que, la principal prioridad debería ser sacarnos de la precariedad antes de crear debates sofisticados sobre la ética de los sistemas biométricos” señala Ana Valdivia

De entre todos los problemas asociados a estos sistemas de reconocimiento facial y de emociones destacan, por ejemplo, la asociación de personas a “tendencias” en base a datos estadísticos. Algo que se realiza continuamente en el ámbito publicitario a través del uso de nuestro perfiles en redes sociales, sin embargo, su uso asociado a sistemas que pueden introducirnos en una base de datos de morosos en el mejor de los casos.

Destaca el hecho, que casi podría asociarse al orden de la frenología, de asociar posturas, rasgos y gestos a determinados comportamientos que se tipifiquen como “criminales o peligrosos”. Las correlaciones estadísticas no implican causa-efecto y es un hecho altamente señalado por expertas que las bases de datos que asocian estas categorías contienen profundos sesgos racistas. Si las cámaras que van a operar en la estación de Renfe de Atocha utilizan las bases de datos creadas por los mismos agentes que, a día de hoy, paran en la estación sistemáticamente a personas que no son blancas, es evidente que estos comportamientos seguirán reproduciéndose.

“Otro problema del que debemos ser muy conscientes es la vulnerabilidad que nos genera que demos este poder al algoritmo. Si el algoritmo se equivoca pero le hemos dado este poder, tenemos que demostrar nosotros que se equivoca. Por ejemplo, imaginemos que te ocurre cuando vas a cruzar una frontera o cuando vas a solicitar un servicio público”, añade Liberal.

Para los autores de la carta, la primera pregunta que debemos plantearnos como sociedad es si realmente necesitamos estos sistemas y en caso de que sí los necesitemos, establecer y cerciorarnos de que funcionan correctamente antes de aplicarlos, algo que está funcionando al revés: se detectan los fallos de los sistemas a partir de su aplicación real.

A pesar de que la carta no pone el foco en ello, sí menciona el hecho de que muchas de estos sistemas tienen un alto componente coercitivo. Independientemente de su funcionamiento y el nivel de error que tienen, el hechpo de que la sociedad sepa que están ahí tiene un claro efecto. Tanto Liberal como Valdivia señalan la importancia de llevar el debate a otras esferas más allá del ámbito técnico y académico. “Creo que hace falta un debate social, necesitamos democratizar la inteligencia artificial para que llegue a todo el mundo, pues nos afecta a todas, aunque impacta más en comunidades vulnerables. Hay que crear redes ciudadanas en las que se traslade el conocimiento entre académicos, actores sociales, políticas, personas de a pie. En la academia debemos crear equipos transdisciplinares que analicen las consecuencias sociales de estas tecnologías”, reflexiona Valdivia.

No obstante, como joven investigadora que ha sufrido los problemas asociados a tratar de abrirse camino en la academia de este país, Valdivia señala claramente las prioridades: “no podemos tener tal debate social si nuestra población está sufriendo los estragos de una crisis social, económica y de salud pública. España tiene una de las mayores tasas de paro en la población juvenil. Lo primero es lo primero. Así que, la principal prioridad debería ser sacarnos de la precariedad antes de crear debates sofisticados sobre la ética de los sistemas biométricos”.

Tecnología

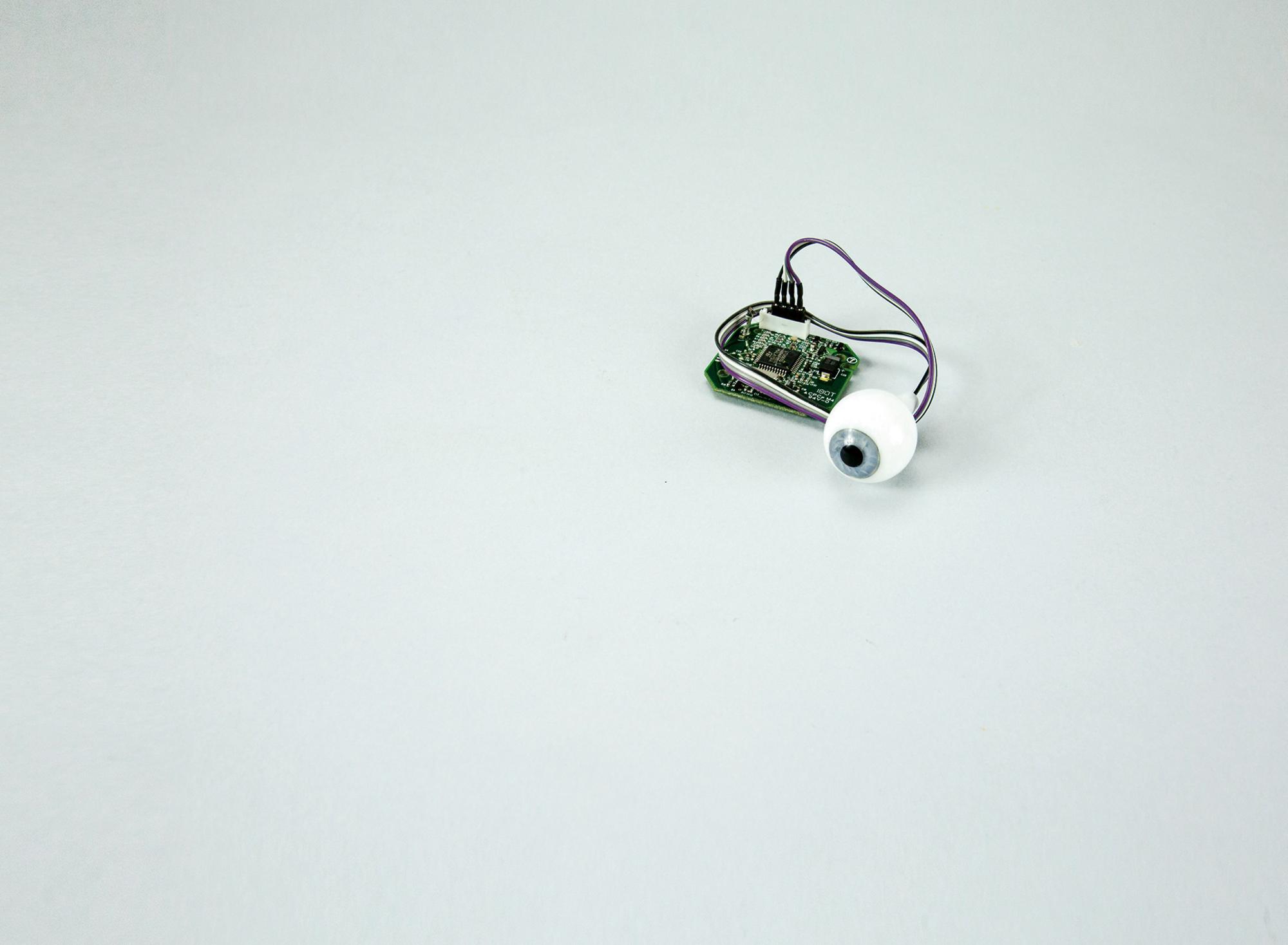

Reconocimiento facial, una distopía para vender humo

Tecnología

El Estado policial español 2.0: tecnologías privadas para vigilar a los ciudadanos

Para comentar en este artículo tienes que estar registrado. Si ya tienes una cuenta, inicia sesión. Si todavía no la tienes, puedes crear una aquí en dos minutos sin coste ni números de cuenta.

Si eres socio/a puedes comentar sin moderación previa y valorar comentarios. El resto de comentarios son moderados y aprobados por la Redacción de El Salto. Para comentar sin moderación, ¡suscríbete!

.jpg?v=63944689192 2000w)

.jpg?v=63944689192 2000w)